مایکروسافت یک چارچوب اتوماسیون open souce به نام PyRIT (مخفف ابزار شناسایی خطر پایتون) را برای شناسایی فعال خطرات در سیستمهای هوش مصنوعی منتشر کرده است.

شانکار سیوا کومار، سرپرست تیم قرمز هوش مصنوعی در مایکروسافت، گفت: این ابزار تیم قرمز به گونهای طراحی شده است که «هر سازمان در سراسر جهان را قادر میسازد تا با جدیدترین پیشرفتهای هوش مصنوعی، مسئولانه نوآوری کند».

این شرکت گفت PyRIT میتواند برای ارزیابی استحکام نقاط پایانی مدل زبانی بزرگ (LLM) در برابر آسیبهای مختلف مانند ساختگی (مثل توهم)، سوء استفاده و محتوای ممنوعه (مانند آزار و اذیت) استفاده شود.

همچنین میتوان از آن برای شناسایی آسیبهای امنیتی از تولید بدافزار تا جیلبریک و همچنین آسیبهای حریم شخصی مانند سرقت هویت استفاده کرد.

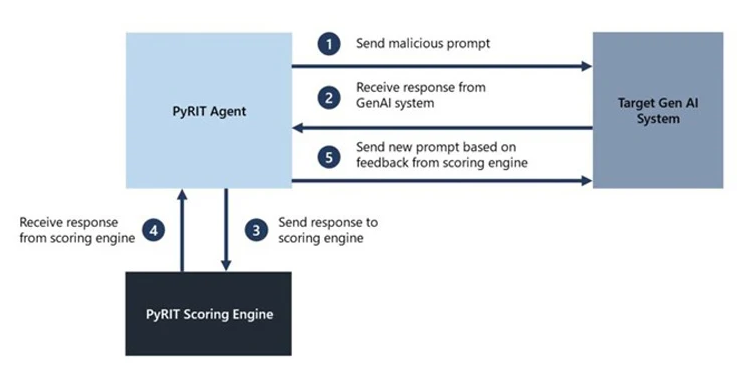

PyRIT با پنج رابط ارائه میشود: هدف، مجموعه دادهها (data set)، موتور امتیازدهی، توانایی پشتیبانی از استراتژی های حمله چندگانه، و ترکیب یک جزء حافظه که میتواند به شکل JSON یا یک پایگاه داده برای ذخیره تعاملات ورودی و خروجی باشد.

موتور امتیازدهی همچنین دو گزینه مختلف برای امتیازدهی به خروجیهای سیستم هوش مصنوعی هدف ارائه میکند، که به تیمهای قرمز اجازه میدهد از یک طبقهبندی کلاسیک یادگیری ماشینی استفاده کنند یا از یک نقطه پایانی LLM برای ارزیابی خود بهرهمند شوند.

مایکروسافت گفت، هدف این است که به محققان اجازه دهیم تا یک خط پایه از عملکرد مدل و کل pipeline استنتاج آنها در برابر آسیبهای مختلف داشته باشند و بتوانند آن خط پایه را با تکرارهای آینده مدل خود مقایسه کنند.

این به آنها اجازه میدهد تا دادههای تجربی در مورد عملکرد امروز مدلشان داشته باشند و هرگونه کاهش عملکرد را بر اساس پیشرفتهای آینده تشخیص دهند.

با این حال، غول فناوری تاکید میکند که PyRIT جایگزینی برای عملکرد غیراتوماتیک تیم قرمز سیستمهای هوش مصنوعی مولد نیست، بلکه ابزاری مکمل محسوب میشود.

به عبارت دیگر، این ابزار به منظور برجسته کردن خطر “hot spot”ها با ایجاد اعلانهایی است که میتواند برای ارزیابی سیستم هوش مصنوعی و پرچمگذاری مناطقی که نیاز به بررسی بیشتر دارند استفاده شود.

سیوا کومار گفت: “کاوشگری دستی، اگرچه زمان بر است، اما اغلب برای شناسایی نقاط کور احتمالی مورد نیاز است.” “اتوماسیون برای مقیاس بندی مورد نیاز است اما جایگزینی برای کاوش دستی نیست.”

این توسعه زمانی صورت میگیرد که Protect AI چندین آسیبپذیری حیاتی را در پلتفرمهای زنجیره تامین هوش مصنوعی محبوب مانند ClearML، Hugging Face، MLflow و Triton Inference Server افشا کند که میتواند منجر به اجرای کد دلخواه و افشای اطلاعات حساس شود.

منبع: https://thehackernews.com/2024/02/microsoft-releases-pyrit-red-teaming.html